为进一步促进大模型性能优化方向的产学研交流合作和人才培养,由中国科学院计算技术研究所承办的大模型性能优化高级研修班近日在北京举行,该研修班面向人工智能或高性能计算等领域的中高级职称专业技术人员和相关企业高级管理人员。

在大模型快速发展和变革的当下,此次培训呼应时代需求,适时为资深行业人士搭建了一个学习研讨前沿技术研究进展的平台,邀请多位学界、业界大咖为大家现场授课。

作为大模型性能优化领域的技术头部企业,清程极智受邀为参与培训的业内人士授课,清程极智联合创始人师天麾、高级研发专家马子轩走进课堂,为同学们带去了大模型训练及推理的相关技术培训,本次培训也将成为线上专业课程在中国科学院继续教育网上发布。

01 详解八卦炉

论文《八卦炉:在3700万以上核心训练脑规模预训练模型》曾在高性能计算领域的顶级会议《第27届并行编程原理与实践会议》上发表,作为该论文的第一作者,清华大学计算机系博士马子轩为现场同学们详解了该系统。

马子轩从设计理念、构成要素、功能等方面对八卦炉进行了解析,他介绍到:人工智能大模型的发展对智能计算提出了新的需求,与智能计算紧密相关的核心基础系统软件成为决定智能算力系统建设和使用水平的关键。

针对此类智能计算基础系统软件的建设需求,“八卦炉”系统诞生,它融合了一系列关键基础软件,包括并行加速系统、智能编译器等。

目前,八卦炉在国际上首次开源了支持PyTorch的大规模混合专家模型训练,在国产超算系统上实现了百万亿参数量的大模型训练加速,推动了智能计算系统软件领域的技术发展。

清程极智高级研发专家马子轩授课

02 细述如何提升高性能国产算力

清程团队孵化于清华大学,将前沿的智能算力理论转化为商业系统软件产品,为国产算力赋能。

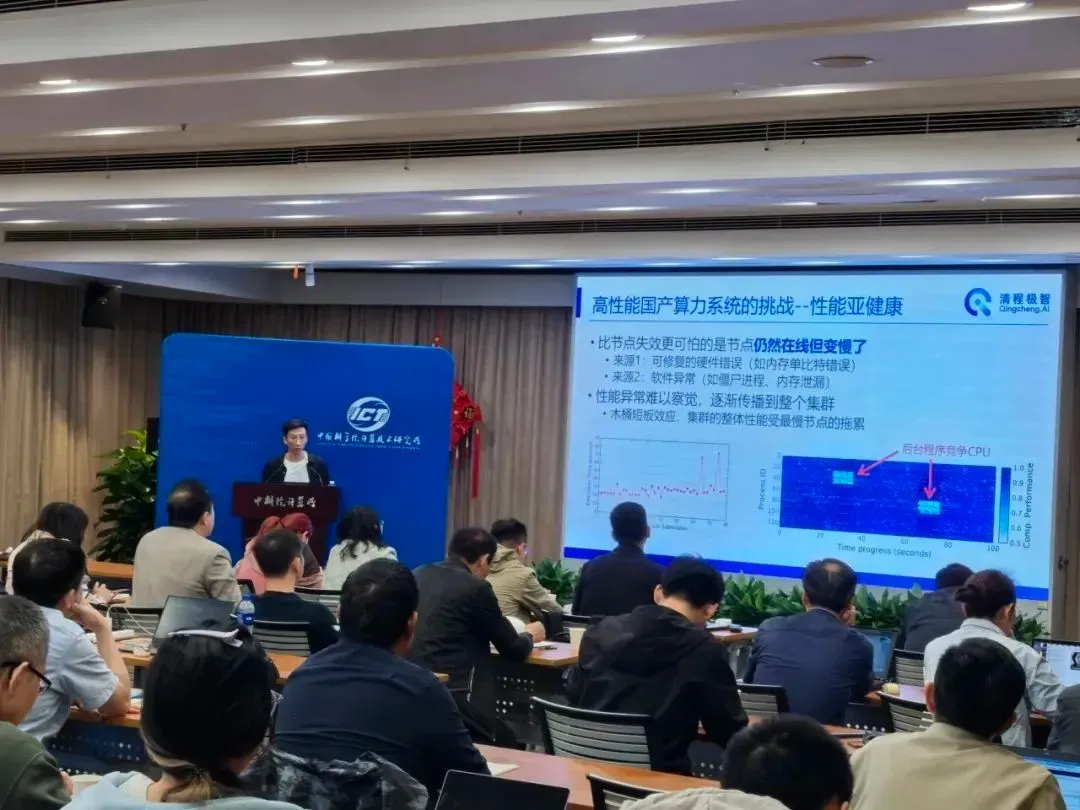

在培训中,清程极智联合创始人,清华大学计算机系博士师天麾,首先分析了高性能国产算力系统利用率不足的原因,并详解了清程极智立足自主研发提出的针对性解决方案。

清程极智的算力系统软件目前能够覆盖大模型落地全栈技术要求,针对智能算力建设、大模型预训练、大模型推理部署、大模型应用构建场景,分别提供国产算力生态适配、超大规模并行训练系统、低延迟高并发推理引擎、云端模型服务平台的对应方案。

就效果而言,师天麾介绍到:“目前清程极智的大模型优化服务,能够让大模型运行效率提升近百倍,大模型应用成本降低2个数量级。”

清程极智联合创始人师天麾授课

在提问环节中,学员们提出多个技术问题,师天麾与马子轩与学员们热烈讨论。

中科院计算所刘瑶表示,清程的培训课程,实现了理论与实践有机结合,给参与培训的学员们提供了关于大模型优化的前沿视角和认知,回应了学员们的困惑和业内关心的关键性问题。随着人工智能大模型的不断发展,培训班将不定期持续举办,联合业内知名企业和学术大咖,以人才培养为抓手,助力国产算力和软件生态的性能优化推进工作。